هذا هو الجزء الثاني من دليل "خارطة طريق الذكاء الاصطناعي المسؤول لمنظمات المجتمع المدني". لمعرفة المزيد، اقرأ مقال "من التوتر إلى المبدأ: كيف يمكن لمنظمات المجتمع المدني الريادة في مجال الذكاء الاصطناعي المسؤول"، ومقدمة الدليل (مع جدول نشر كل جزء)، والجزء الأول: "الاستكشاف" - تهيئة الأرضية.

في الجزء الثاني: الإنشاء، استعد لتحديد أهم مبادئ مؤسستك، وتعلّم كيفية تعريفها.

1.2 منهجية البحث عن القيم الأساسية

هذا الإطار مقتبس من كتاب أوليفيا غامبلين "الذكاء الاصطناعي المسؤول"، الذي يقدم منهجا عمليا للمؤسسات لتحديد القيم المتوافقة عبر الأبعاد التنظيمية والبيئية والتنظيمية.

← استخدم ورقة عمل "تحديد | تعريف مبادئ الذكاء الاصطناعي" لإتمام هذا القسم. تحتوي ورقة العمل على جدول تقييم التوافق وجميع المراجع الداعمة.

التمهيد:

إذا جمعتَ نقاط التوتر من خلال مقابلات ما قبل الجلسة، فابدأ بعرض الأفكار المُستخلصة على المجموعة. شارك الأنماط التي سمعتها: الآمال والمخاوف والثوابت التي ظهرت. امنح المجموعة وقتا للرد وإضافة ما تم جمعه.

إذا كنتَ تُناقش نقاط التوتر مباشرةً، فابدأ بالأسئلة الخمسة. خصص 5 دقائق للتأمل الفردي، ثم 15-20 دقيقة للمشاركة الجماعية. دوّن كل شيء على لوحة ورقية أو مستند مشترك.

مع ظهور التوترات، أصبح لدى فريقك الآن ما يلي:

رؤى مستقاة من المقابلات أو التأمل (ما يهمك حمايته)

جرد للذكاء الاصطناعي يوضح ما هو قيد الاستخدام وما هي المخاوف القائمة

الحكمة المتراكمة: قيم مؤسستك، واللوائح ذات الصلة، والمعايير المرجعية في هذا المجال

الآن، اجمع هذه المعلومات لتحديد المبادئ الأكثر أهمية.

بناء قائمة مبادئك:

ابدأ بتجميع جميع المبادئ التي جمعتها من خلال الاستكشاف:

مبادئ الذكاء الاصطناعي المسؤول الشائعة من الأطر وأبحاث المعايير المرجعية (أكثر 6-12 مبدأً استشهادًا)

قيم ومبادئ مؤسستك الحالية

أي مبادئ برزت من مناقشات التوترات (على سبيل المثال، إذا تكرر ذكر "الأصالة"، فقد يشير ذلك إلى مبدأ مثل "الإنسان في الجوهر")

المبادئ التي تفرضها بيئتك التنظيمية

من المرجح أن يكون لديك 12-20 مبدأً مرشحا. لا بأس بذلك. الخطوة التالية تساعدك على تحديد الأولويات.

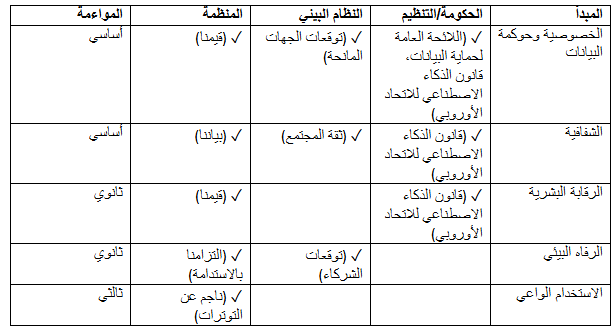

تقييم التوافق:

لكل مبدأ، قيّم مدى ملاءمته عبر ثلاثة أبعاد:

(مسودة نموذجية)

← تتضمن ورقة عمل تحديد مبادئ الذكاء الاصطناعي وتعريفها هذا الجدول جاهزا للتعبئة، بالإضافة إلى مرجع قانون الذكاء الاصطناعي في الاتحاد الأوروبي ومواءمة المبادئ لمساعدتك في إكمال عمود الحكومة/اللوائح.

كيف تُسهم مرحلة "الاستكشاف" في ذلك:

عمود الحكومة/اللوائح: يُحدد بحثك في البيئة التنظيمية المبادئ المطلوبة أو المُشجعة قانونا.

عمود النظام البيئي: يُحدد فهمك لتوقعات المُمولين والشركاء والمجتمع المبادئ المهمة لأصحاب المصلحة.

عمود المؤسسة: تُحدد قيمك الحالية ورؤيتك للتحديات المبادئ الأساسية لهويتك.

تُعدّ مناقشة التحديات ذات قيمة خاصة هنا. إذا أبدى فريقك قلقًا بالغًا بشأن الأصالة، فهذا يُشير إلى مبادئ مثل "الإنسان في صميم العمل". إذا تكرر ذكر خصوصية البيانات في القائمة، فهذا يُشير إلى "الخصوصية وحوكمة البيانات" كمبدأ أساسي.

تقييم المواءمة:

أساسي (3 علامات): يظهر المبدأ في جميع المصادر الثلاثة. هذا مبدأ جوهري وغير قابل للتفاوض.

ثانوي (علامتان): يظهر المبدأ في مصدرين. مهم، يدعم عملية اتخاذ القرار عند تعارض المبادئ الأساسية.

ثالثي (علامة واحدة): يظهر المبدأ في مصدر واحد فقط. قد يظل مهما لمؤسستك تحديدا، حتى وإن لم يُشدد عليه في مصادر أخرى.

استهدف من 3 إلى 7 مبادئ أساسية. زيادة العدد عن ذلك يُعيق العمل؛ وقلة العدد قد تُغفل جوانب مهمة. تُصبح هذه المبادئ الأساسية محور تركيزك للتعريف التفصيلي.

2.2 من التحديد إلى التعريف

تحديد المبادئ ليس سوى نصف العمل. مبدأ مثل "الإنصاف" أو "الشفافية" يحمل معاني مختلفة لمؤسسات مختلفة. مهمتك هي تعريف معنى كل مبدأ في سياقك.

← تتضمن ورقة عمل تحديد مبادئ الذكاء الاصطناعي وتعريفها نموذج تعريف لكل مبدأ. استخدمه لتسجيل إجابات فريقك على الأسئلة أدناه.

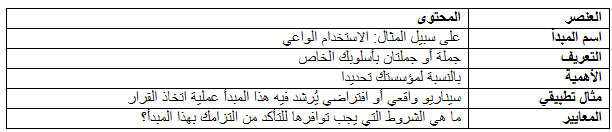

أسئلة التعريف:

لكل مبدأ حددته كمبدأ أساسي (واختياريا كمبدأ ثانوي)، اعملوا كفريق على الإجابة عن هذه الأسئلة:

ماذا يعني هذا المبدأ لمؤسستنا في سياق الذكاء الاصطناعي؟ كيف يرتبط برسالتنا وقيمنا والعمل المحدد الذي نقوم به؟ ما الذي يجعل تفسيرنا فريدا؟

لماذا يُعدّ هذا المبدأ مهما لنا؟ ما هي الفوائد المحتملة من الالتزام به؟ وما هي المخاطر أو العواقب السلبية المترتبة على عدم الالتزام به؟

هل يمكنك ذكر مثال محدد يُظهر أهمية هذا المبدأ أو يُواجه تحديات؟ اربط ذلك بواقع عملك؛ سيناريو حقيقي أو حالة افتراضية واقعية.

ما هي المعايير التي تُساعدنا على تقييم مدى التزامنا بهذا المبدأ؟ ما هي الشروط التي يجب توافرها؟

دراسة حالة: أكاديمية خان

تبنّت أكاديمية خان مبدأ "تحقيق الأهداف التعليمية"، لكنها لم تكتفِ بالاسم. بل وضعت معايير تُوضّح ما يتطلبه تطبيق هذا المبدأ:

"وجود هدف تعليمي واضح يُمكن تحقيقه من خلال استخدام الذكاء الاصطناعي"

"وجود خطة للرصد والتقييم لتحديد الأثر"

"وجود آليات لمنع استخدام الذكاء الاصطناعي في غير الأغراض التعليمية"

لاحظ أن هذه ليست قواعد تنفيذية مُفصّلة، بل هي معايير على مستوى المبدأ. فهي تُحدّد ما يتطلبه المبدأ دون تحديد كيفية تحقيقه بدقة. تأتي هذه التفاصيل لاحقًا، عند وضع السياسات (للمزيد من المعلومات، انقر هنا) وإجراء تقييمات المخاطر (للمزيد من المعلومات، انقر هنا).

تكمن أهمية تحديد المبادئ على هذا المستوى في قدرة الفريق على طرح الأسئلة التالية: "هل لميزة الذكاء الاصطناعي المقترحة هدف تعليمي واضح؟ هل لدينا خطة لقياس الأثر؟ ما هي الآليات التي تمنع إساءة الاستخدام؟" يُقدّم المبدأ الأسئلة، بينما تُقدّم السياسات وتقييمات المخاطر الإجابات.

دراسة حالة: ChangemakerXchange

عرّفت CXC مفهوم "الاستخدام الواعي" من خلال أسئلة محددة يطرحها فريقها قبل أي استخدام للذكاء الاصطناعي:

"هل الذكاء الاصطناعي ضروري حقا لهذه المهمة؟"

"هل يتوافق حقا مع قيمنا؟"

"ما الذي سأخسره عند استخدام هذه الأداة لهذه المهمة؟"

كما حددوا أيضا كيفية تطبيق ذلك عمليا: "تتطلب بعض المهام حضورنا الكامل واهتمامنا، مثل كتابة رسالة صادقة للأعضاء، أو وضع نظرية للتغيير، أو تصميم جلسة لأحد اجتماعاتنا. عندما يتم تفويض مثل هذه المهام بشكل مفرط إلى الذكاء الاصطناعي، فإنها تُخاطر بفقدان العمق والأصالة والمعنى."

يصبح المبدأ قابلاً للتنفيذ لأنه يتم تحديده من حيث عملهم المحدد.

المخرجات: ← استخدم ورقة "تحديد مبادئ الذكاء الاصطناعي المسؤول" في ورقة عمل "تحديد | تعريف مبادئ الذكاء الاصطناعي" لتسجيل هذه المخرجات لكل مبدأ.

تُشكّل هذه التعريفات أساسا لهياكل الحوكمة والسياسات الخاصة بك.

3.2 أهمية تنوّع الآراء

إنّ من يشارك في هذه العملية لا يقلّ أهمية عن العملية نفسها.

لماذا يُعدّ التنوع مهما؟

يرى الأشخاص الأقرب إلى مهمتك المخاطر التي تغفل عنها القيادة.

يفهم موظفو الخطوط الأمامية كيف يؤثر الذكاء الاصطناعي فعليا على العمل اليومي.

يمكن لأعضاء المجتمع التحدث عن التأثيرات التي قد تتجاهلها الفرق الداخلية.

تمنع وجهات النظر المتنوعة نقاط الضعف والتفكير الجماعي.

عندما يشارك الأفراد في وضع المبادئ، يصبحون حماة لتلك القيم.

من ينبغي أن يكون حاضرا؟

القيادة (للحصول على الموافقة والصلاحية للالتزام).

موظفو البرامج/العمليات (للحصول على رؤية عملية).

الكادر التقني، إن وجدوا (للحصول على رؤى حول الجدوى).

الاتصالات/العلاقات الخارجية (للحصول على وجهة نظر أصحاب المصلحة).

الموظفون الإداريون (غالبا ما يكونون من أوائل مستخدمي الذكاء الاصطناعي لأدوات الكفاءة)

إن أمكن: أعضاء المجتمع، أو المستفيدون، أو الشركاء.

انبثق بيان CXC من الاستماع العميق عبر فريقهم. ويتم الحفاظ على إطار عمل أكاديمية خان من خلال فريق عمل متعدد الوظائف يضم فرق المنتج والبيانات وبحوث المستخدمين، مما يضمن تشكيل وجهات نظر متنوعة لنهجهم.

نصائح للتيسير:

خلق بيئة آمنة نفسيا: لا أحكام مسبقة، ولا إجابات "خاطئة".

استخدام التأمل الفردي قبل المناقشة الجماعية (يمنع الأصوات المهيمنة من توجيه النقاش).

دعوة المشاركين الأقل حماسا للمشاركة.

توثيق الآراء المخالفة، وليس فقط الإجماع.

النظر في آليات إدخال البيانات المجهولة للمخاوف الحساسة.

التأكيد على أن الاختلاف في الرأي يُعدّ معلومة، وليس فشلا.

تجنب "الاستعراض المؤسسي":

الهدف ليس إنتاج وثيقة مصقولة تُعتمد من قِبل القيادة، بل الهدف هو المشاركة الحقيقية في الإبداع: مبادئ يؤمن بها فريقك لأنهم ساهموا في صياغتها.

إذا كشفت جلستك الأولى عن اختلاف حقيقي في الرأي، فهذه ميزة، وليست عيبا. هذه التوترات تُعدّ معلومات. قد تشير إلى حاجتك لمزيد من الحوار قبل الالتزام بمبدأ ما، أو إلى ضرورة تعريف المبدأ بدقة أكبر لاستيعاب وجهات النظر المختلفة.

عملية وضع المبادئ لا تقل أهمية عن المبادئ نفسها.

تأكد من متابعتك للجزء الثالث: التطبيق العملي، لتتعلم كيفية تحديد مبادئ الذكاء الاصطناعي الأكثر أهمية لمنظمتك.

ملاحظاتكم تهمنا

هذه المقالة هي الجزء الثاني من سلسلة "خارطة طريق الذكاء الاصطناعي المسؤول لمنظمات المجتمع المدني"، والتي تم تطويرها كجزء من مشروع الذكاء الاصطناعي من أجل التغيير الاجتماعي ضمن برنامج النشاط الرقمي التابع لـ TechSoup، بدعم من Google.org.