هذا هو الجزء الأول من "خارطة طريق الذكاء الاصطناعي المسؤول لمنظمات المجتمع المدني". للاطلاع على المقدمة، يُرجى النقر هنا.

ما يُنتجه الاستكشاف:

التوترات الظاهرة (من خلال المقابلات أو التأمل)

جرد أولي للذكاء الاصطناعي (ما هي الأدوات المستخدمة، وما هي البيانات التي تتعامل معها، وما هي المخاوف القائمة)

مجموعة من الخبرات المتراكمة (اللوائح المعمول بها، وقيم مؤسستك الحالية، والمعايير المرجعية من الميدان)

كل هذا يُصبح مادة خام لمرحلة الإنشاء.

1.1 البدء بالتوترات

إن أقوى نقطة انطلاق هي إدراك التعقيد الذي يشعر به فريقك بالفعل. يوجد الذكاء الاصطناعي في فضاء من التوتر الإبداعي؛ الكفاءة مقابل الأصالة، والابتكار مقابل الأمان، والوصول مقابل الخصوصية. هذه التوترات ليست مشاكل يجب حلها، بل هي بوابات لقيمك.

نهجان:

الخيار أ: مقابلات تمهيدية قبل الجلسة

يقوم شخص واحد بإجراء مقابلات قصيرة مع أعضاء الفريق قبل الجلسة الجماعية. اطرح الأسئلة الخمسة بشكل فردي، وانتبه للأنماط، ثم قدم الأفكار المُجمعة للمجموعة خلال جلسة الإبداع. يرتكز هذا النهج على الإنصات العميق قبل الإبداع التعاوني. يُجدي هذا النهج نفعا عندما:

ترغب في الكشف عن مخاوف صادقة قد لا يُفصح عنها الأفراد في المجموعة

لديك أصحاب مصلحة متنوعون ذوو وجهات نظر مختلفة

ترغب في أن تُركز جلسة الإنشاء على التجميع بدلا من الاكتشاف الأولي

الخيار ب: التفاعل المباشر أثناء الجلسة

اجمع الفريق واعملوا على الأسئلة الخمسة معا خلال جلسة الإنشاء. خصص وقتا للتأمل الفردي قبل المناقشة الجماعية. يُجدي هذا النهج نفعا مع الفرق الصغيرة أو عندما يكون بناء فهم مشترك بنفس أهمية المحتوى نفسه.

يُجدي هذا النهج نفعا عندما:

يكون فريقك صغيرا ويتمتع ببيئة عمل آمنة نفسيا

يُعدّ الاكتشاف المشترك جزءا من الهدف

يكون وقت التحضير محدودا

الأسئلة الخمسة:

سواء جُمعت مسبقًا أو نوقشت أثناء الاجتماع، تُبرز هذه الأسئلة المادة الخام لمبادئك:

1. علاقتنا بالذكاء الاصطناعي

كفريق، ما هي المشاعر التي تنتابنا عند التفكير في الذكاء الاصطناعي؟

لا تتجاهلوا هذه النقطة. هل يشعر أحدكم بالحماس؟ بالقلق؟ بالفضول؟ بالإرهاق؟ بالشك؟ سمّوا هذه المشاعر. دوّنوها. لا بأس أن تكون معقدة ومتناقضة. هذه ليست جلسة علاج نفسي، بل هي فهم للسياق. لا يمكنكم إجراء حوار بنّاء حول المبادئ دون فهم الحالة النفسية السائدة.

2. آمالنا

ما هي النتيجة الإيجابية التي نأمل تحقيقها من خلال الذكاء الاصطناعي؟

ما الذي سيصبح ممكنا ولم يكن ممكنا من قبل؟ ما المشاكل التي يمكننا حلّها؟ ما الذي يمكننا فعله بشكل أفضل، أو أسرع، أو بنطاق أوسع؟ دعوا الجميع يحلمون هنا. هذه هي الطاقة الدافعة، التي تجذبكم نحو ما تريدون بناءه.

3. مخاوفنا

ما هو الضرر الذي نلتزم بشدة بمنعه؟

إذا ساءت الأمور، كيف سيكون الوضع؟ ما هي النتيجة التي ستجعلكم تقولون: "كان يجب ألا نفعل هذا أبدا"؟ ما هو خطك الأحمر، الحد الذي لن تتجاوزه قطعا؟ هل يمكنك وصف استخدام محدد للذكاء الاصطناعي يبدو خاطئا جوهريا بالنسبة لمؤسسة مثل مؤسستنا، حتى لو كان فعالا من الناحية التقنية؟ ما الذي يتجاوز الخط الأخلاقي؟

هذه هي طاقة "الضوابط"، إدراك ما يجب عليك الحماية منه.

4. مبادئنا غير القابلة للتفاوض

بالنظر إلى قيمنا التنظيمية الحالية، أيها الأكثر أهمية للحفاظ عليه عند تبني الذكاء الاصطناعي؟

معظم المؤسسات لديها بالفعل قيم معلنة. أي من هذه القيم تبدو الأكثر عرضة للخطر في سياق الذكاء الاصطناعي؟ أيها يجب أن يوجه كل شيء آخر؟

ما هو الجزء من عملك الذي يجب أن يبقى دائما إنسانيا بالكامل، حيث أن مساعدة الذكاء الاصطناعي ستُضعف ما تقوم به بدلًا من تعزيزه؟ ما الذي يجب "عزله" عن الأتمتة؟

هذا يربط مبادئك المتعلقة بالذكاء الاصطناعي بهويتك التنظيمية.

5. بوصلتنا

إذا كان بإمكاننا اختيار 3-5 مبادئ فقط لتوجيه عملنا في مجال الذكاء الاصطناعي، فماذا ستكون ولماذا؟

ازرع هذه الفكرة مبكرا. ستعود إليها بمزيد من المعلومات في مرحلة الإنشاء.

ما يجب توثيقه:

وثّق كل شيء: التوترات المحددة التي يذكرها الأفراد، والمخاوف، والآمال، والأنماط. عندما تتكرر عبارات أو كلمات معينة، مثل "الأصالة" أو "ثقة المجتمع"، فهذه إشارة إلى مبادئك.

2.1 ابدأ جرد الذكاء الاصطناعي

متى يتم ذلك: قبل جلسة المجموعة، إن أمكن. يمكن لشخص واحد أو مجموعة صغيرة إعداد مسودة أولية للجرد، ثم التحقق منها وتوسيعها مع الفريق بأكمله خلال جلسة "الإنشاء".

← استخدم ورقة جرد الذكاء الاصطناعي في ورقة عمل "تحديد | تعريف مبادئ الذكاء الاصطناعي" لتوثيق أدوات الذكاء الاصطناعي الخاصة بمؤسستك ومخاوفها.

لماذا هذا مهم:

يجعل الحوار ملموسا (ليس مبادئ مجردة، بل "نحن نستخدم هذه الأدوات")

يكشف التوترات بشكل طبيعي (يُظهر الجرد مواطن عدم اليقين لدى المؤسسة)

يوفر مادة خام لتحديد المبادئ (تُحدد الأدوات ومخاطرها المبادئ الأكثر أهمية)

يكشف "الذكاء الاصطناعي الخفي" - الأدوات التي يستخدمها أعضاء الفريق بشكل غير رسمي دون موافقة المؤسسة

هيكل الجرد:

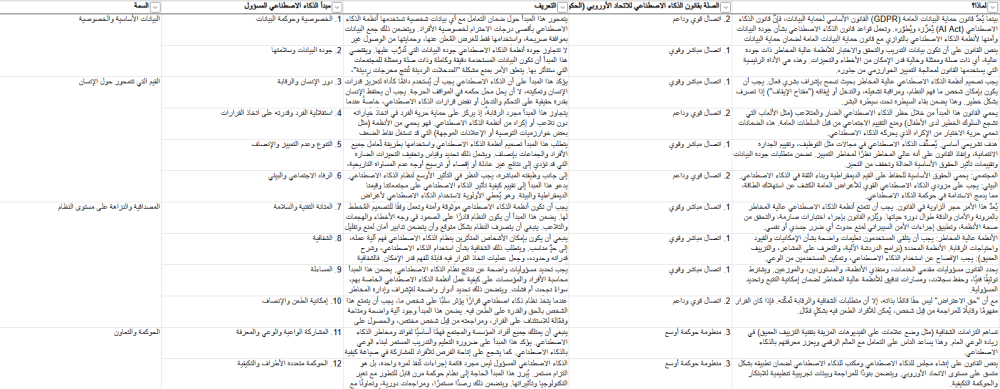

الشكل 1: محتوى هذا الجدول مثال توضيحي، يمكنك الاطلاع عليه وعلى الجدول القابل للتعديل هنا.

الشكل 1: محتوى هذا الجدول مثال توضيحي، يمكنك الاطلاع عليه وعلى الجدول القابل للتعديل هنا.

هام: لا يمتلك أي أداة ذكاء اصطناعي حالة ثابتة. تعتمد الحالة على الأداة وحالة الاستخدام وحساسية البيانات. قيّم المهمة المحددة دائما قبل البدء.

فئات الحالة:

🟢 أخضر: مسموح

🟡 أصفر: استخدم بحذر، مسموح ولكن فقط باتباع ضوابط محددة

🔴 أحمر: ممنوع. لا تستخدمه.

⚪ رمادي: في مرحلة الاستكشاف/الرغبة.

مستويات حساسية البيانات:

عام: لا توجد مخاوف بشأن الكشف

داخلي: للاستخدام التنظيمي فقط

سري: وصول محدود، يحتوي على معلومات تنظيمية حساسة

شديد الحساسية: يحتوي على بيانات شخصية، أو معلومات المستفيدين، أو محتوى محمي قانونا.

نصيحة للتيسير: عند جمع معلومات الجرد، وفر بيئة آمنة للإفصاح الصادق. غالبًا ما يستخدم الأشخاص أدوات ذكاء اصطناعي لم يذكروها لأنهم غير متأكدين من "مسموح" بها. يمكن لآليات الإدخال المجهولة أن تساعد في الكشف عن استخدام الذكاء الاصطناعي الخفي.

احتفظ بهذا الجرد كوثيقة حية. سيزداد تفصيلاً مع تطوير هياكل الحوكمة والسياسات في مرحلة الإنشاء.

← صُممت ورقة جرد الذكاء الاصطناعي في ورقة العمل ليتم تحديثها بمرور الوقت. ابدأ ببساطة، وأضف التفاصيل كلما تعمق فهمك.

3.1 جمع الخبرات السابقة

متى يتم ذلك: قبل جلسة المجموعة. يمكن لشخص واحد تجميع هذه المعلومات وعرضها خلال اجتماع الإنشاء، مما يضمن وجود أساس مشترك للفريق للعمل عليه.

ما يجب جمعه:

القيم والمبادئ الحالية لمؤسستك

بيان المهمة، الخطة الاستراتيجية، مدونة قواعد السلوك

أي سياسات تقنية أو بيانات حالية

بيانات القيم من وثائق التأسيس

الالتزامات المقدمة للممولين أو الشركاء أو المجتمعات

اسأل: كيف يمكن تطبيق هذه القيم الحالية على الذكاء الاصطناعي؟

البيئة التنظيمية الخاصة بك

ما هي اللوائح التي تنطبق على سياقك؟ (قانون الاتحاد الأوروبي للذكاء الاصطناعي، اللائحة العامة لحماية البيانات، المتطلبات الخاصة بالقطاع)

ما الذي يتوقعه الممولون فيما يتعلق باستخدام الذكاء الاصطناعي أو حماية البيانات؟

ما الذي يتوقعه مجتمعكم؟

هل توجد معايير مهنية في قطاعكم؟

بالنسبة لمنظمات المجتمع المدني الأوروبية، تشمل المبادئ الأساسية لقانون الذكاء الاصطناعي في الاتحاد الأوروبي الإشراف البشري، والشفافية، وجودة البيانات، وعدم التمييز. حتى خارج الاتحاد الأوروبي، توفر هذه الأطر نقاط مرجعية مفيدة.

← راجعوا ورقة عمل "مواءمة قانون ومبادئ الذكاء الاصطناعي في الاتحاد الأوروبي" (أكثر مبادئ الذكاء الاصطناعي المسؤول شيوعا) في ورقة العمل القابلة للتنزيل (تحديد | تعريف مبادئ الذكاء الاصطناعي) لفهم المبادئ التي تحظى بدعم تنظيمي.

معايير من الميدان

يعمل مجتمع عالمي على تطوير مبادئ الذكاء الاصطناعي المسؤول منذ عام 2019. لستم بحاجة إلى البحث في كل هذا بأنفسكم. لقد جمعنا لكم أهم الأطر والأمثلة ذات الصلة.

← راجع مورد "معايير مبادئ الذكاء الاصطناعي المسؤول" للاطلاع على أمثلة من منظمات ذات رسالة محددة، بما في ذلك أكاديمية خان، وChangemakerXchange، وCommon Sense Media، وغيرها.

← راجع ورقة مبادئ الذكاء الاصطناعي المسؤول الأكثر شيوعا في ورقة العمل القابلة للتنزيل (تحديد | تعريف مبادئ الذكاء الاصطناعي) للاطلاع على تعريفات المبادئ الأكثر استخدامًا في أطر عمل الاتحاد الأوروبي، ومنظمة التعاون الاقتصادي والتنمية، واليونسكو، والمعهد الوطني للمعايير والتكنولوجيا.

المخرجات:

وثيقة مُجمّعة أو عرض تقديمي موجز يُقدّم هذه المعرفة في جلسة الإنشاء:

ملخص للوائح ذات الصلة بسياقكم

قيم مؤسستكم الحالية (مع ملاحظات حول أهمية الذكاء الاصطناعي)

ورقة مرجعية للمبادئ الشائعة (مرفقة)

مثال أو مثالان من مؤسسات مماثلة تتوافق مع رسالتكم

الهدف ليس الإلمام بكل إطار عمل، بل امتلاك سياق كافٍ يمكّن فريقكم من اتخاذ قرارات مدروسة بشأن المبادئ الأكثر أهمية لمؤسستكم. الموارد التي نوفرها تُسهّل العمل، ودوركم هو تقديم منظور مؤسستكم الفريد.

تابع الدليل بالجزء الثاني: "الإنشاء - تحديد مبادئك وتعريفها"، لتتعرف على كيفية تحديد مبادئ الذكاء الاصطناعي الأكثر أهمية لمنظمتك المجتمعية، والجزء الثالث: "التطبيق العملي"، لتتعرف على كيفية تحديد مبادئ الذكاء الاصطناعي الأكثر أهمية لمنظمتك المجتمعية.

رأيك يهمنا

ما رأيك في هذا النص؟ خصص 30 ثانية لمشاركة رأيك ومساعدتنا في إنشاء محتوى قيّم للمجتمع المدني!

نموذج الملاحظات سيأتي قريباً!

هذه المقالة هي بداية سلسلة "خارطة طريق الذكاء الاصطناعي المسؤول لمنظمات المجتمع المدني"، التي طُوّرت كجزء من مشروع "الذكاء الاصطناعي من أجل التغيير الاجتماعي" ضمن برنامج النشاط الرقمي التابع لـ TechSoup، بدعم من Google.org.